引言

为应对上述挑战,研究者们早期开发了多种基于传统机器学习算法的MRI颅内肿瘤分类方法.传统的MRI颅内肿瘤分类方法通常依赖手工特征提取与经典机器学习算法,但这类方法存在诸多自身的技术局限性.例如,手工特征难以全面捕捉肿瘤复杂的生物学特征;不同MRI影像设备与成像协议的差异导致模型泛化性能较差;计算效率不足也使得诊断流程耗时较长,难以满足实际临床需求[8].

目前,已有多种机器学习方法被广泛应用于MRI颅内肿瘤分类任务中,包括支持向量机(Support Vector Machine,SVM)、随机森林(Random Forest,RF)以及K近邻(K-Nearest Neighbors,KNN)等经典算法[9]. 其中,SVM方法在小规模数据集上表现出良好性能,但难以处理更加复杂的特征模式;随机森林方法虽然准确性较高,但参数调优复杂;而KNN方法则由于简单直接的实现机制,在处理大规模数据集时面临高昂的计算成本.近年来,随着深度学习技术的迅猛发展,卷积神经网络(Convolutional Neural Network,CNN)凭借其自动的分层特征学习能力,已成为MRI颅内肿瘤分类领域的主流方法,尤其在大规模医学影像数据处理方面展现出显著优势[10].

越来越多的研究致力于利用卷积神经网络实现多类别颅内肿瘤的高效识别,这主要归功于其在高级特征表达及医学图像分析等视觉任务中的突出表现.例如,Paul等人[2]比较了全连接网络与CNN在颅内肿瘤分类中的适用性;Asfhar等人[7]提出了用于颅内肿瘤分类的胶囊网络(CapsNet),通过动态路由机制提升空间结构建模能力,但其网络结构复杂、训练过程不稳定.随后,他们改进的CapsNet不仅处理脑部MRI图像,还引入了肿瘤粗略边界作为输入,以提升性能.Swati等人[10]采用VGG19结合块状微调(Block-wise Fine-Tuning,BFT)方法对颅内肿瘤进行分类,但该方法对预训练权重依赖程度较高,对硬件资源要求较大.Ghassemi等人[11]训练了一个作为生成对抗网络(Generative Adversarial Network,GAN)判别器的深度神经网络,并将其应用于颅内肿瘤分类任务.为了进一步优化CapsNet的结构,Afshar等人[12]提出了增强胶囊网络(BoostCaps);Bodapati等人[13]将Xception和InceptionResNetV2提取的特征通过平均池化方式融合,构建了双通道深度神经网络结构.与此同时,Kalkhof等人[14]提出了基于神经元元胞自动机的轻量级神经网络Med-NCA,实现了对医学图像的稳健分割,为后续分类任务提供了更加精确的区域特征.最新研究[15]基于边界柯里萤火虫算法(Border Collie Firefly Algorithm,BCFA)与GAN相结合的方法,用于肿瘤分级分类,但生成式方法对训练样本质量较为敏感,模型泛化能力仍需进一步提升.

尽管基于卷积神经网络(CNN)的方法在颅内肿瘤分类性能方面实现了一定提升,但传统CNN在捕捉同一类别肿瘤内部的微小尺度差异及类别之间的细粒度特征时仍存在局限性.此外,传统CNN在建模全局依赖关系方面能力有限,这在一定程度上增加了其实际临床应用的难度.近年来,注意力机制被引入到CNN架构中,作为提升模型性能的关键组件.注意力机制能够引导模型聚焦于关键信息区域,有效抑制无用特征,从而在多个计算机视觉任务中取得了显著成效[16

(1)将二分类与三分类结合的训练策略,大大缩短了模型的训练时间并减少了对计算资源的需求.这种方法不仅提高了训练效率,还通过轻量化网络结构,使模型更适合在资源受限的环境中部署.

(2)引入动态卷积,该技术能够根据图像的不同部分自动调整滤波器响应,从而针对颅内肿瘤图像中多变的形状和尺寸提供更精确的特征提取.这一策略显著提高了模型对颅内肿瘤图像中不同病变区域的适应性和识别精度.

(3)通过融合通道注意力机制,AD-Net进一步增强了对图像中关键特征的关注能力.该机制通过聚焦于最具信息量的特征通道,优化了网络的特征提取过程,从而提高了分类的准确性和模型的解释性.

1 研究方法

1.1 实验流程

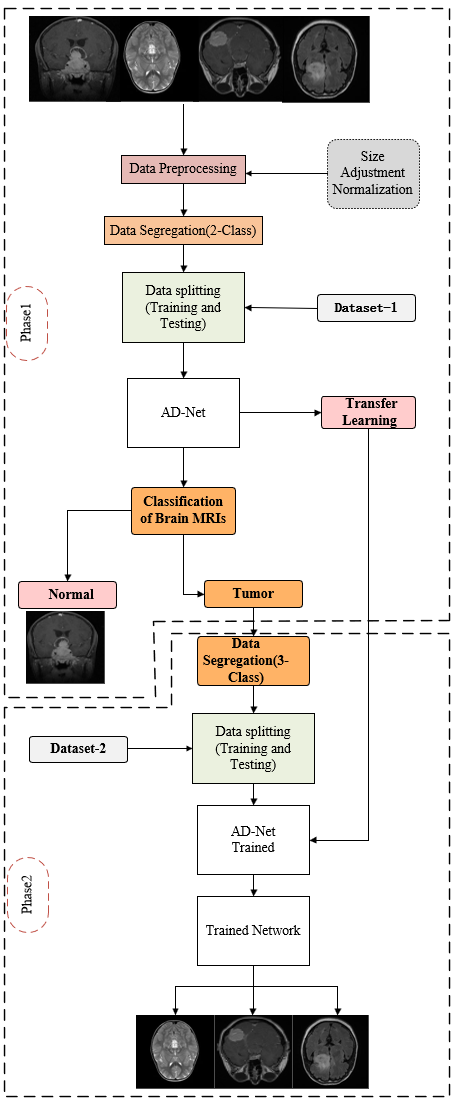

本文提出二分类结合三分类的流程,如图1所示,旨在提高分类精度并显著降低计算复杂性.整个流程分为两个阶段进行,具体而言,以确保既能够快速地识别无肿瘤的图像,又可以精确地区分肿瘤类型.首先,输入的MRI图像被送入预处理阶段,这里进行图归一化和尺寸调整,以统一输入图像的标准,提升后续模型识别的效率和准确性.接下来进入第一阶段,该阶段使用数据集一(Dataset-1)对图像进行二分类,即判断图像中是否存在肿瘤,目的是快速筛选出正常脑组织图像和存在肿瘤的图像.经过AD-Net特征提取,并利用训练出的网络权重,可迅速区分正常与异常图像,从而避免了后续对所有图像进行三分类的计算负担,显著降低了计算复杂性,提升了整体处理效率.当确认图像中存在肿瘤后,再将筛选出来的肿瘤图像送入流程的第二阶段,此阶段使用数据集二(Dataset-2)进行更精细的三分类任务,以区分不同类型的肿瘤(胶质瘤、脑膜瘤和垂体瘤).第二阶段利用第一阶段训练网络的权重作为初始化,以迁移学习的方式进一步进行训练,从而提高了分类模型的泛化性能和训练速度.由于二分类任务有效减少了大量不必要的计算,使得这一阶段的三分类任务更具针对性,模型在较少的数据中就能快速达到高精度.两阶段的分类策略在保证高分类精度的同时,大幅减少了计算负荷,并且有效利用了迁移学习的优势,使得整个颅内肿瘤分类流程更加高效、更具实用价值,尤其适用于临床诊断需求高效率、高精确度的医疗场景.

图1

1.2 网络整体结构

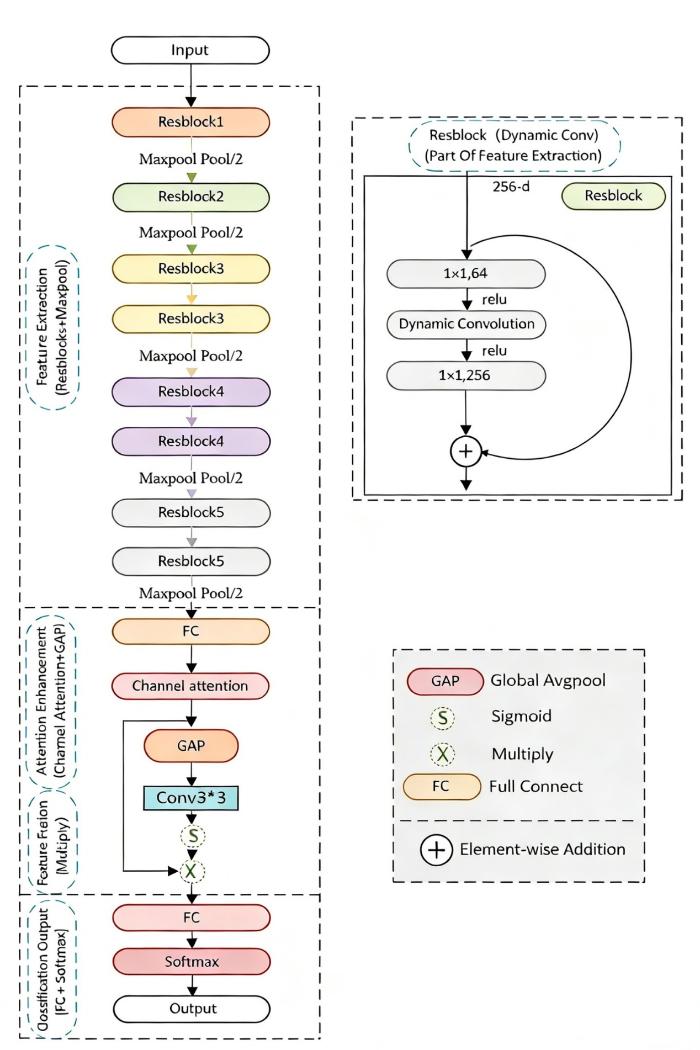

基于ResNet50改进后的深度学习网络(AD-Net)如图2所示,主要针对三种颅内肿瘤类型以及正常脑部图像进行分类.整个网络的设计可以分为特征提取(Feature Extraction)、注意力增强(Attention Enhancement)、特征融合(Feature Fusion)以及分类输出(Classification Output)四个主要部分.

图2

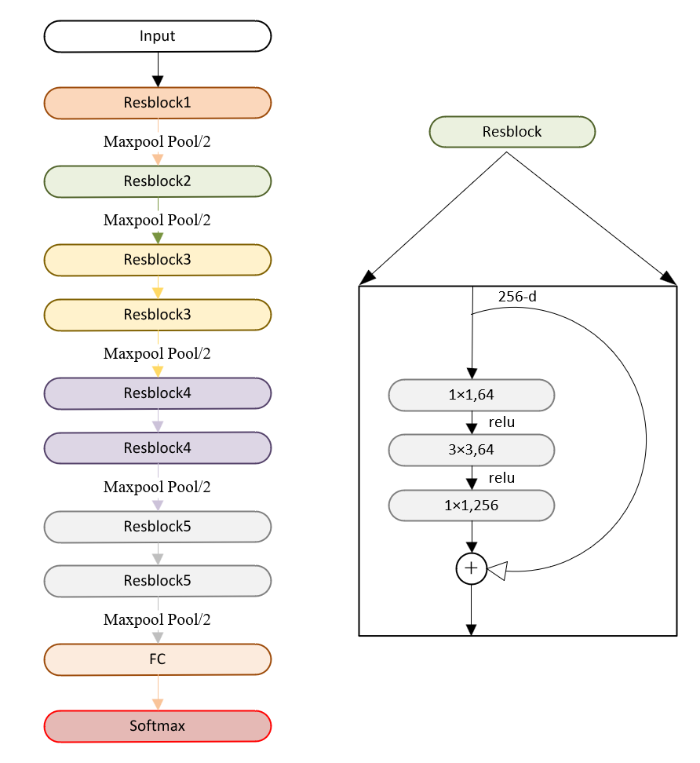

1.3 ResNet50基础网络

图3

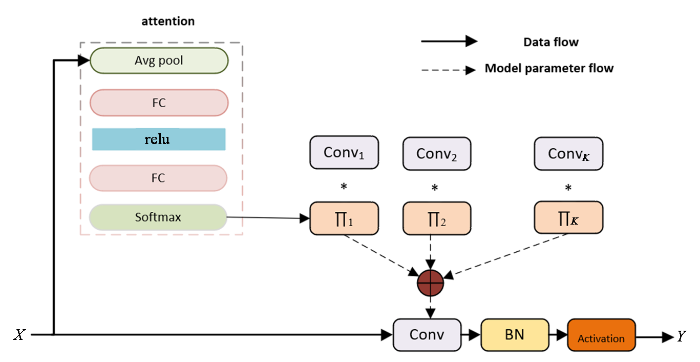

1.4 动态卷积模块

图4

该模块通过通道注意力机制自适应调整不同卷积核的权重,以提升特征提取能力.首先,利用全局平均池化捕获全局特征,并通过两层全连接(FC)+ relu计算注意力分布,经过Softmax归一化后生成K组动态权重.随后,依据这些权重对K组预设卷积核进行加权求和,得到最终动态卷积核,并用于卷积操作.最终,通过归一化(Batch Normalization, BN)和非线性激活函数优化输出特征.该方法使卷积操作具备更强的自适应性,有助于提升模型的特征表征能力和泛化能力.该模块具体计算过程如下:

首先对于输入特征X,使用注意力模块增强模型对重要特征的感知能力,使用通道注意力模块提取通道特征:

其中Xpool表示通道平均特征,提取每通道全局信息;Xhidden为非线性特征表示,提取压缩后的通道嵌入;A表示注意力分布权重,决定动态卷积组合方式;T表示Softmax中的温度系数,控制注意力的选择性;avgpool表示全局平均池化,relu表示激活函数,FC表示全连接层.接下来通过多组动态卷积计算模型的输出Yout,预设K组卷积,首先进行注意力加权求和:

其中Conv表示卷积操作,Convk表示第k个预设卷积核,Wdyn表示动态组合的卷积核,Ak表示第k个卷积核的注意力权重,Activation表示激活层.

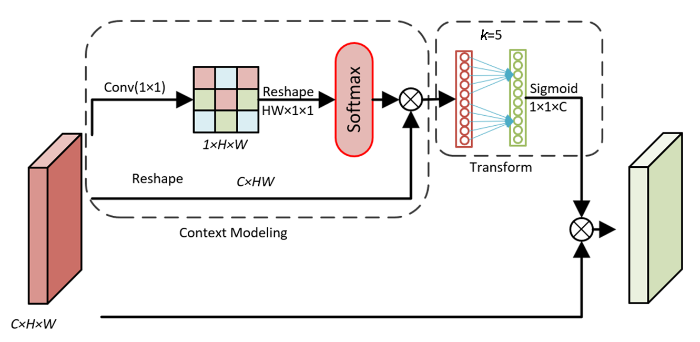

1.5 通道注意力机制

图5中展示的是一种专门设计的通道注意力模块,其目的是增强网络对颅内肿瘤MRI图像特征的长距离依赖关系建模能力.在本文的颅内肿瘤分类任务中,不同通道的特征表达着肿瘤组织与正常组织的重要区别,捕捉这些通道之间的全局关系能显著提升分类的准确性.

图5

具体而言,通道注意力模块首先将输入的特征图

其中

其中Conv表示核为1的卷积操作,

其中

使用全局上下文特征提取模块提取特征后,本文进一步使用Transform注意力对特征进行提取,得到注意力增强特征.首先使用一个k=5个神经元的多层感知机(MLP)对上下文特征进行建模,得到

其中,MLP代表多层感知机,最后一层使用Sigmoid激活函数进行激活,得到通道重要性特征

其中σ 表示Sigmoid激活函数,S的值在0~1之间.

最后将通道重要性特征S与输入特征X进行逐通道相乘,得到最终的输出

其中

1.6 损失函数

本文采用加权交叉熵损失作为损失函数,加权交叉熵损失函数公式为:

其中,c和M分别是肿瘤类别和类别数目.w表示类别权重,y表示类别标签,p表示预测概率.

2 实验结果与分析

2.1 数据集及预处理

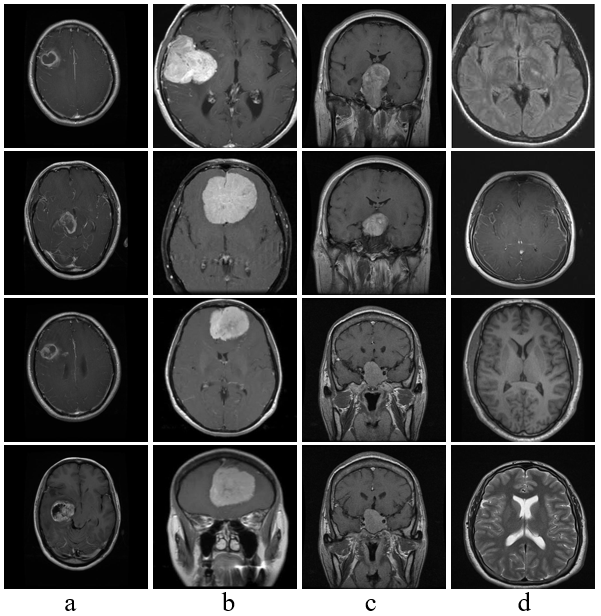

本研究收集了两个包含正常和肿瘤脑部影像的数据集,均来自开源平台Kaggle,分别命名为Dataset-1和Dataset-2.其中,Dataset-1数据集包含3 762张MRI影像(有肿瘤1 683张,无肿瘤2 079张),该数据集用于实验中二分类任务.Dataset-2数据集包含7 023张MRI影像(脑膜瘤1 621张,胶质瘤1 645张,垂体瘤1 757张,无肿瘤2 000张),该数据集的图像数量较为均衡,用于实验中三分类任务的训练和评估.图6展示了从Dataset-1和Dataset-2数据集中抽取的正常与肿瘤脑部影像的样本,直观地展示了本研究使用的影像类型和质量.通过这种系统的实验流程和深入的数据分析,旨在提高颅内肿瘤分类的准确性,为临床诊断提供有效的辅助工具.

图6

图6

从Dataset-1和Dataset-2数据集中抽取的正常与肿瘤脑部影像的样本. a: 胶质瘤; b: 脑膜瘤; c: 垂体瘤; d: 无肿瘤

Fig. 6

Samples of normal and tumor brain images extracted from Dataset-1 and Dataset-2. a: Glioma, b: Meningioma, c: Pituitary, d: No tumor

为了确保数据质量并提升模型的训练效果,本研究对数据进行了规范化的预处理.首先,采用数据归一化,将图像像素值调整至标准范围,以提高模型训练速度并防止数值不稳定的问题.其次,对所有图像统一分辨率,使其满足模型输入的尺寸要求,有效避免尺寸差异带来的训练困难.

2.2 参数设计与模型评估

训练网络模型的设备内存为256 GB,处理器为IntelXeon6246,GPU为NVIDIA RTX 4090由NVIDIA公司(美国)生产,深度学习框架为Pytorch 2.1.2,CUDA 11.8,Python 3.8.训练时采用Adma优化器进行优化.实验设置的迭代的批量大小为128,训练次数为60,所有图像均统一调整为224×224像素,以适配主流卷积神经网络的输入尺寸.

此外,为评估模型在实际部署中的可行性,本文在NVIDIA RTX 4090显卡平台上测量了AD-Net在推理阶段的速度,平均处理每张MRI图像耗时约12.6 ms,显示出该模型具备快速响应和临床部署的潜力.

为了准确评估网络的性能,本文采用 Accuracy(准确率)、Precision(精确率)、Recall(召回率)、F1分数、Kappa系数以及混淆矩阵作为评价指标.

Accuracy(准确率)是指分类器对给定测试数据集中正确分类的样本数与总样本数之比:

其中,TP表示真正例,模型正确预测为正类的样本数量;TN表示真反例,模型正确预测为负类的样本数量;FP表示假正例,模型将负类错误预测为正类的样本数量;FN表示假反例,模型将正类错误预测为负类的样本数量.

Precision(精确率)是指分类器判定为正样本中,真正为正样本所占的比例:

Recall(召回率)是指在真实正样本中,被正确判定为正样本的比例:

F1分数是精确率与召回率的调和平均值:

Specificity(特异性)是衡量模型识别负类(非目标类)能力的指标:

Kappa系数是用于一致性检验的指标,也可用于衡量分类效果:

其中,

2.3 实验设计

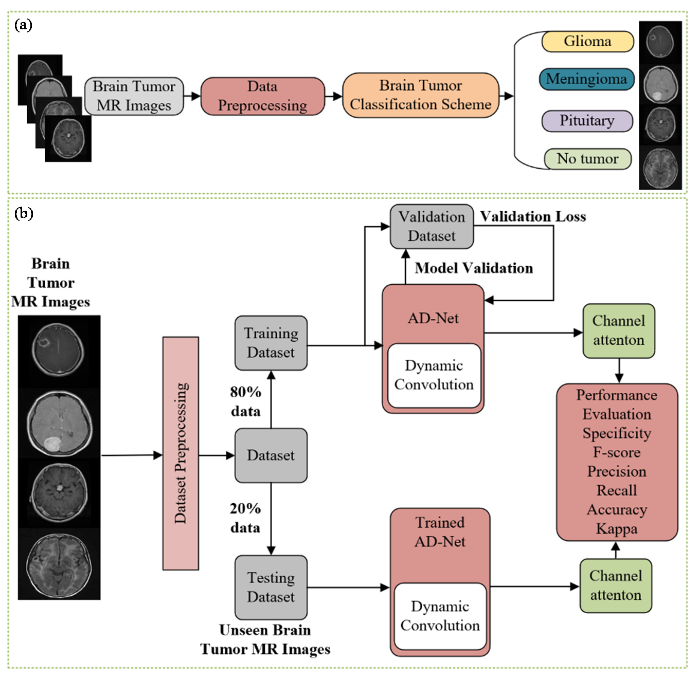

图7展示了本文所提出的基于AD-Net的颅内肿瘤MRI图像分类框架,整体分为两个部分:(a)部分为整体分类流程概览,(b)部分为模型训练与测试阶段.在(a)部分中,系统首先以颅内肿瘤MRI图像作为输入,经过数据预处理(Data Preprocessing).预处理后的图像被送入颅内肿瘤分类模块(Brain Tumor Classification Scheme),该模块可将图像分为四类:胶质瘤(Glioma)、脑膜瘤(Meningioma)、垂体瘤(Pituitary)以及无肿瘤(No tumor).这一步为整个系统提供了基础的分类目标.在(b)部分中,流程展示了AD-Net模型的训练和推理细节.首先,对原始数据集进行划分,其中80%的数据作为训练集,20%作为测试集.训练集被输入到AD-Net模型中,AD-Net集成了动态卷积模块(Dynamic Convolution)和通道注意力模块(Channel Attention),前者增强了模型对局部特征的自适应建模能力,后者则使模型更关注对分类有贡献的通道特征.在训练阶段,模型还利用验证集对网络性能进行实时监控与优化,通过最小化验证损失(Validation Loss)进行模型调整,提升网络的泛化能力.训练好的AD-Net模型被用于对测试集中的未见明显颅内肿瘤的图像进行分类.在测试阶段,图像同样经过动态卷积与通道注意力模块处理,以实现对图像类别的准确预测.最终,模型输出的结果将通过多种评估指标进行性能分析,包括特异性(Specificity)、F1分数(F1-Score)、精确率(Precision)、召回率(Recall)、准确率(Accuracy)以及Kappa系数.这些评价指标从不同维度反映了模型的分类效果、鲁棒性和泛化能力.

图7

图7

本文所提出的基于AD-Net的颅内肿瘤MRI图像分类框架. (a)实验简易流程; (b)实验详细流程

Fig. 7

The AD-Net-based framework for intracranial tumor MRI image classification proposed in this paper. (a) Simplified experimental procedure, (b) Detailed experimental procedure

2.4 结果与分析

在本研究中,我们提出了一个新的深度学习框架AD-Net,用于颅内肿瘤的识别和分类.通过五折交叉验证方法对数据集进行划分,确保了训练和测试的数据独立性和代表性.

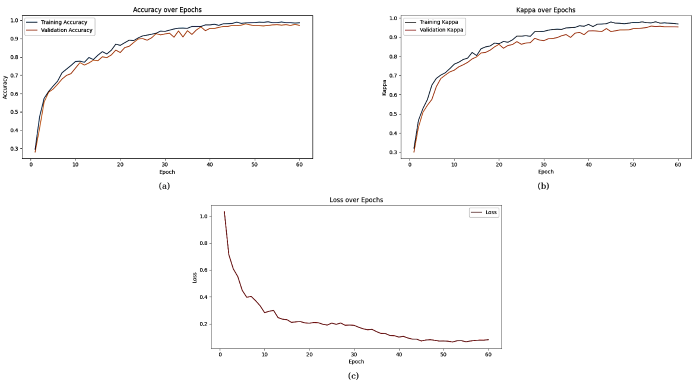

图8展示了AD-Net模型在多个训练周期(Epoch)中的几个关键性能指标:训练准确率(Training Accuracy)、验证准确率(Validation Accuracy)、训练Kappa系数值(Training Kappa)、验证Kappa系数值(Validation Kappa)和损失(Loss)变化情况.每个子图从左至右分别代表了训练和验证过程中这些指标的变化,反映了模型在学习过程中的行为和性能调整.模型的训练损失逐渐下降,并在一定的训练周期后趋于稳定,这表明模型逐步从训练数据中学习到了有价值的特征.此外,训练和验证的精度以及Kappa系数值也随着周期的增加而提高,反映了模型在识别颅内肿瘤图像方面的准确性逐渐增强.特别是在后期周期,验证精度和Kappa系数值达到了最高,说明模型具有良好的泛化能力.我们还注意到,在某些周期后,尽管训练精度持续提高,但验证精度和Kappa系数值却出现了波动或下降,这可能是模型开始出现过拟合的迹象.为此,我们引入了提前停止的策略,即如果验证损失在连续多个周期内没有显著下降,则停止训练.这有助于保持模型的泛化能力,避免无谓的计算资源浪费.

图8

图8

AD-Net模型在60个训练周期(Epoch)中的几个关键性能指标(a)训练准确率与验证准确率、(b)训练Kappa系数与验证Kappa系数及(c)损失函数曲线图

Fig. 8

of the AD-Net model over 60 training epochs: (a) training and validation accuracy, (b) training and validation Kappa values, and (c) loss function curves

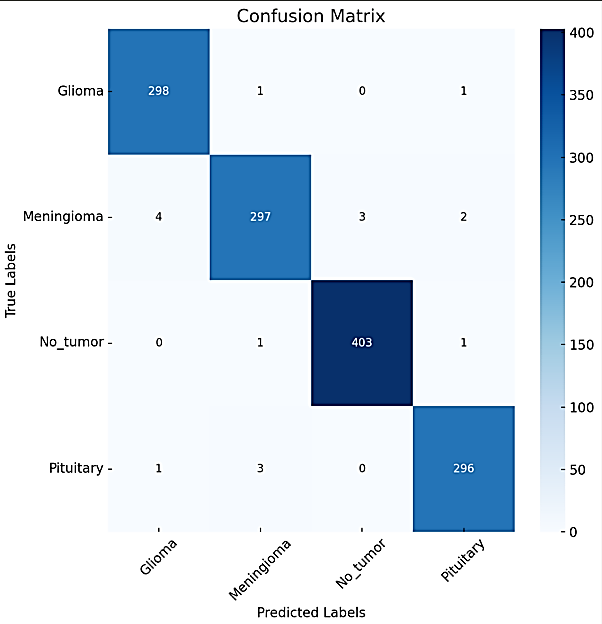

在实验的最后,我们在测试集上对模型进行了最终评估.如图9所示的混淆矩阵清晰地展示了模型对于胶质瘤、脑膜瘤、垂体瘤以及无肿瘤四个类别的分类结果.从混淆矩阵中可以观察到,模型在区分各类颅内肿瘤时表现出很高的准确性,整体分类准确率达到了0.974 7.此外,计算得到的二次加权Kappa系数值为0.977 3,进一步验证了模型预测结果的高度一致性与稳定性,说明AD-Net模型在颅内肿瘤图像分类任务中表现出了优越性和鲁棒性.

图9

2.5 对比实验

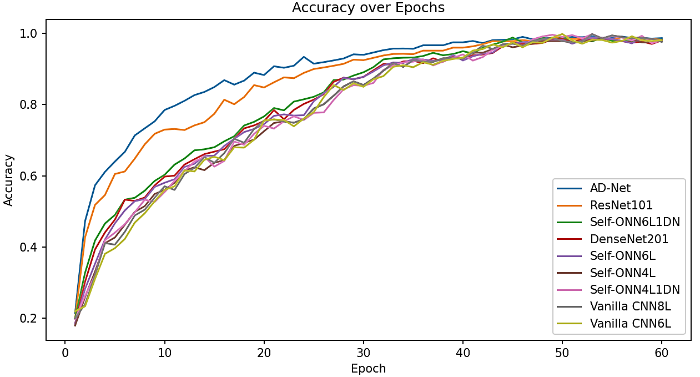

图10

所有模型均使用相同的原始MRI颅内肿瘤图像数据集进行训练,以确保评估的公平性.这些模型旨在对四个类别进行分类:胶质瘤、垂体瘤、脑膜瘤以及无肿瘤.从图10可以明显看出,AD-Net模型的学习曲线在训练初期迅速上升,并在整个训练周期内保持高准确率,显示出其快速收敛和高泛化能力.

对比的分类性能结果显示在表1中.结果表明,尽管传统的深层CNN模型如DenseNet201和ResNet101在准确率上表现优秀,但AD-Net在所有对比模型中表现最为突出,达到了最高的分类性能.具体来说,AD-Net在原始MRI颅内肿瘤图像上展现了0.974 7的准确率、0.969 3的精确率、0.968 5的召回率、0.979 5的特异性和0.968 3的F1分数.

表1 对比实验结果

Table 1

| 模型名称 | 准确率(Accuracy) | 精确率(Precision) | 召回率(Recall) | 特异性(Specifity) | F1分数(F1 Score) |

|---|---|---|---|---|---|

| Self-ONN4L1DN | 0.9390±0.0129 | 0.9348±0.0133 | 0.9377±0.013 | 0.9434±0.0125 | 0.9350±0.0133 |

| Self-ONN4L | 0.9376±0.0130 | 0.9356±0.0132 | 0.9376±0.0130 | 0.9428±0.0125 | 0.9375±0.0131 |

| Self-ONN6L | 0.9419±0.0126 | 0.9485±0.0119 | 0.9429±0.0125 | 0.9547±0.0112 | 0.9458±0.0122 |

| Self-ONN6L1DN | 0.9650±0.0112 | 0.9553±0.0111 | 0.9520±0.0115 | 0.9611±0.0104 | 0.9531±0.0114 |

| Vanilla CNN8L | 0.9295±0.0138 | 0.9289±0.0139 | 0.9292±0.0138 | 0.9395±0.0129 | 0.9278±0.0140 |

| Vanilla CNN6L | 0.9283±0.0139 | 0.9276±0.0140 | 0.9290±0.0139 | 0.9387±0.0129 | 0.9245±0.0143 |

| DenseNet201 | 0.9458±0.0122 | 0.9455±0.0122 | 0.9428±0.0125 | 0.9584±0.0108 | 0.9480±0.0120 |

| ResNet101 | 0.9490±0.0107 | 0.9596±0.0106 | 0.9589±0.0107 | 0.9589±0.0107 | 0.9586±0.0107 |

| AD-Net | 0.9747±0.0092 | 0.9693±0.0093 | 0.9685±0.0094 | 0.9795±0.0076 | 0.9683±0.0095 |

此外,为了定量评估模型性能,我们还考虑了测试数据的平均值和标准偏差.测试数据集被均匀分为五折,以测试模型的稳定性和可靠性.AD-Net模型在这些评估中显示出较低的标准偏差值,表明其性能在不同测试集上的变异性较小,从而证明了其优越的稳定性和可靠性.这一点从表1的统计数据可以得到进一步的证实.

因此,可以得出结论,AD-Net在将MRI颅内肿瘤图像分类为四个类别方面表现优于其他对比模型,证实了其作为颅内肿瘤诊断工具的实用性和有效性.未来的工作将进一步探索该模型在更广泛医学影像任务中的潜力及应用.

2.6 消融实验

为验证本文所提AD-Net模型的有效性,我们将其与其他几种模型进行了对比,包括ResNet50[23]、ResNet50加入通道注意力模块[26](Channel Attention)和动态卷积[28](Dynamic Convolution)的改进版本. 这种比较旨在展示AD-Net在不同组件增强下的性能变化,以及这些改进如何促进模型在颅内肿瘤分类任务中的表现.表2中的消融实验结果显示了各模型的分类性能,包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)、F1分数(F1 Score)和Kappa系数.从表中数据可以看出,原始的ResNet50模型准确率为0.936 2,加入通道注意力的ResNet50模型准确率提高到0.951 9,显示通道注意力机制的有效性;而加入动态卷积后,模型准确率提升至0.960 1,表明动态卷积在特征提取方面的有效性.AD-Net模型在全部评价指标上表现最优,准确率达到0.974 7,显著优于其他对比模型。该模型以ResNet50为基础,融合了动态卷积与通道注意力机制,能够自适应调整特征提取过程中的权重分布,更有效地捕捉颅内肿瘤MRI图像中的关键信息.其高性能得益于模型能够同时关注全局和局部特征,以及通过高效的多尺度特征融合策略提高分类的准确性.这不仅有助于模型识别不同类型肿瘤间的宏观差异,还能够细致地捕捉肿瘤间的细微差别,从而提升了颅内肿瘤分类的整体性能.

表2 消融实验结果

Table 2

| 模型名称 | 准确率(Accracy) | 精确率(Precision) | 召回率(Recall) | F1分数(F1 Score) | Kappa |

|---|---|---|---|---|---|

| ResNet50 | 0.9362 | 0.9251 | 0.9331 | 0.9434 | 0.9325 |

| ResNet50+Channel Attention | 0.9519 | 0.9369 | 0.9550 | 0.9552 | 0.9484 |

| ResNet50+Dynamic Convolution | 0.9601 | 0.9553 | 0.9433 | 0.9565 | 0.9526 |

| AD-Net | 0.9747 | 0.9693 | 0.9685 | 0.9683 | 0.9773 |

3 结论与展望

本文针对颅内肿瘤MRI图像分类任务,提出了一种高效、轻量化的深度学习模型——AD-Net.该模型通过融合动态卷积模块和通道注意力机制,在提升特征表达能力的同时,有效地降低了模型复杂度和计算资源消耗.实验表明,AD-Net在多个开源MRI脑部影像数据集上,尤其是在复杂的多类别分类任务中,均取得了优异的分类效果.模型在准确率、精确率、召回率、F1分数和Kappa系数等评价指标上全面优于传统深度学习方法,显示出良好的泛化性能和实际应用潜力.进一步地,AD-Net在推理速度上表现突出,能够满足临床实际部署对实时性的要求,尤其适合资源受限的医疗场景.

尽管取得了显著成果,本文研究仍存在一定的局限性.首先,对于假阳性和假阴性结果尚未展开深入系统的分析.在实际临床中,假阳性可能导致无肿瘤患者承担不必要的诊疗风险和经济负担,而假阴性会遗漏真实患者,延误治疗,带来严重后果.本研究在分析模型预测结果时,发现极少数正常样本被误判为肿瘤(如脑膜瘤),提示模型在处理边界模糊或影像质量较差的样本时仍有改进空间.其次,目前的模型训练与测试主要依赖于开源数据集,不可避免地存在与真实复杂临床环境之间的分布差异.数据集样本量、采集设备、成像协议等因素的差异,都可能影响模型在实际中的泛化能力和鲁棒性.

鉴于以上不足,未来的研究可从以下几个方面予以拓展:

(1)加强假阳性与假阴性机制分析:引入更为细致的错误分析工具,对模型误判样本进行深入溯源,结合放射科专家的人工标注,共建高质量的标注数据集,提高模型对边界复杂和异质性样本的判别能力.进一步,还可设计专门损失函数或采用样本重加权策略,缓解类别不平衡对预测结果的影响.

(2)提升模型可解释性和临床信任度:在现有Attention可视化基础上,构建统一的可解释性框架,将模型的显著特征区域和诊断依据以可视化方式呈现,辅助医生理解模型诊断逻辑.并通过与医生诊断结果的系统性对比,评估模型的辅助诊断价值和实际应用局限.

(3)跨数据集、跨机构泛化验证:未来可收集更大规模、跨平台、跨中心的多源医学影像数据集,涵盖不同人群、成像设备与协议.通过域自适应、迁移学习等方法提升模型的鲁棒性与普适性,缩小模型性能在不同实际场景间的差异.

(4)推动多模态与多任务深度学习研究:进一步将MRI与CT、PET、临床电子病历等多模态信息结合,探索端到端的多模态特征融合网络.同时,根据实际临床需求,将肿瘤的分级、分区、预后与随访等多任务联合建模,完善智能影像辅助诊断生态.

(5)引入隐私保护和协作学习机制:在法律法规与伦理框架下,引入联邦学习等分布式机器学习技术,实现多医疗中心间隐私安全的数据协作训练,提升模型训练数据多样性,保障数据主权.

综上所述,AD-Net为颅内肿瘤MRI图像的智能分类提供了高效实用的技术方案,对智能医疗影像诊断具有重要的理论和应用意义.未来,随着多维数据融合、模型可解释性增强以及安全协同学习机制等技术的不断成熟,基于深度学习的医学影像智能诊断有望在临床精准医疗中发挥更大作用.

利益冲突

无

参考文献

Bayescap: A bayesian approach to brain tumor classification using capsule networks

[J].DOI:10.1109/LSP.97 URL [本文引用: 1]

A classification method for cerebral aneurysms in TOF-MRA based on improved 3D ResNet50 model

[J].

基于3D ResNet50改进模型的TOF-MRA脑动脉瘤分类方法

[J].

DOI:10.11938/cjmr20243119

[本文引用: 2]

脑动脉瘤的不规则形态,尤其是子瘤的存在,是动脉瘤破裂风险的关键因素.临床上对子瘤的评估主要是通过时间飞跃法磁共振血管造影(Time of Flight-Magnetic Resonance Angiography,TOF-MRA)进行图像重建及基于医生视觉和经验的判断,这限制了诊断的效率和准确性.本文提出了一种基于3D ResNet50改进的并行多尺度注意力融合网络(Parallel Multiscale Attention Fusion Networks,PMAF-Net)的子瘤自动分类方法,PMAF-Net采用多尺度卷积并加权融合通道和空间注意力权重以提高特征提取能力.实验所用TOF-MRA数据291例,其中训练集128例,验证集32例,测试集131例.与其他分类网络比较,PMAF-Net在测试集上表现最好,准确率为83.97%,召回率为84.48%,精确率为80.33%,F1分数为0.823 5,受试者工作特征曲线(ROC)也显示出模型最佳的分类性能(AUC为0.900 8).实验结果表明该网络能更准确地识别出子瘤型动脉瘤,有望对动脉瘤破裂风险评估和量化提供支持.

Deep learning for brain tumor classification

[C]//

Ldmres-Net: a lightweight neural network for efficient medical image segmentation on iot and edge devices

[J].

A segmentation network for pancreatic cystic tumors integrating dual decoder and global attention upsampling module

[J].

融合双解码和全局注意力上采样模块的胰腺囊性肿瘤分割网络

[J].

DOI:10.11938/cjmr20233073

[本文引用: 1]

胰腺因其解剖结构复杂多变、周围环境复杂等特点,始终是医学图像分割中最具挑战性的任务之一.针对以上问题,提出一种融合双解码和全局注意力上采样模块的深度学习分割模型(Combining Dual Decoding and Global Attention Upsampling Modules Network,DGANet).模型由一个编码器和两个解码器构成,两个解码器实现了对不同深度特征信息的充分利用;模型采用全局注意力上采样模块(Global Attention Upsampling,GAU),利用高层丰富的语义信息来引导低层选择更为精准的特征信息.利用长海医院提供的数据集进行实验,结果表明平均Dice相似系数为86.28%,交并比(Intersection-over-Union,IoU)为0.77,豪斯多夫距离(Hausdorff Distance,HD)为7.7 mm,数据证实了该模型在胰腺囊性肿瘤分割中具有一定的临床意义和价值.

Research progress on segmentation of multi-modal cardiac medical images using traditional methods and deep learning

[J].

传统方法和深度学习用于不同模态心脏医学图像的分割研究进展

[J].

DOI:10.11938/cjmr20233086

[本文引用: 2]

随着老龄化加剧,心血管疾病患病人数逐年增加,借助医学图像实现心脏功能的评估在诊疗过程中起着重要作用.心脏分割是评估心脏功能的前提,一直受到临床医生和科学研究者的密切关注.本文从传统方法和深度学习方法角度梳理了近十年以来关于心脏分割研究的文献.重点介绍了基于主动轮廓和图谱模型的传统分割方法,以及基于U-Net和全卷积神经网络(FCN)的深度学习算法.其中针对通过增加局部模块、优化损失函数、强化网络结构等方式改进深度学习网络以实现心脏特定区域精准分割这一主题进行了详细展开,并从心脏磁共振、X射线计算机断层扫描(CT)和超声3种成像模态对上述方法进行总结.最后总结了该领域目前的研究现状并对未来研究方向进行了展望.

Capsule networks for brain tumor classification based on MRI images and coarse tumor boundaries

[C]//

MLU-Net: A multi-level lightweight U-Net for medical image segmentation integrating frequency representation and MLP-based methods

[J].DOI:10.1109/ACCESS.2024.3360889 URL [本文引用: 1]

Multi-source feature classification model for pancreatic mucinous and serous cystic neoplasms based on deep learning

[J].

基于深度学习的胰腺黏液性和浆液性囊性肿瘤的多源特征分类模型

[J].

DOI:10.11938/cjmr20233064

[本文引用: 1]

术前精准预测胰腺囊性肿瘤的类型,对制定个体化诊疗方案具有重要的临床价值.针对胰腺浆液性和黏液性囊性肿瘤的分类鉴别问题,本文探讨了基于深度学习的多源特征分类模型在胰腺囊性肿瘤的术前辅助诊断中的应用.首先,通过深度学习和影像组学技术从分割图像中提取深度学习特征和影像组学特征,并对病例的临床特征进行评估和量化,然后采用最小绝对收缩选择算子(LASSO)及交叉验证的方法筛选特征,随之构建出两个多源特征模型,即影像组学联合深度学习(RAD_DL)模型、临床特征联合RAD_DL(Clinical_RAD_DL)模型,把传统的影像组学(RAD)模型和深度学习(DL)模型作为对照,最后选用支持向量机(SVM)、自适应提升算法(ADAboost)、随机森林(Random Forest)以及逻辑回归(Logistic)进行分类.采用准确率、召回率、精确率、曲线下面积(AUC)值以及精确率和召回率的调和平均数(F1值)作为评价指标,比较上述4种不同特征模型的分类效能,用校准曲线和决策曲线来评估其临床应用价值.结果显示Clinical_RAD_DL特征模型的分类效能表现最佳,准确率是0.923 1,召回率是0.882 4,精确率是0.882 0,F1是0.882 2,AUC是0.912 6,校准曲线和决策曲线显示出Clinical_RAD_DL特征模型的临床应用价值是最高的.实验表明基于深度学习的多源特征分类模型,对胰腺黏液性和浆液性囊性肿瘤具有较好的分类效果,可以为临床上精准诊疗提供帮助.

Brain tumor classification for MR images using transfer learning and fine-tuning

[J].DOI:10.1016/j.compmedimag.2019.05.001 URL [本文引用: 2]

Deep neural network with generative adversarial networks pre-training for brain tumor classification based on MR images

[J].DOI:10.1016/j.bspc.2019.101678 URL [本文引用: 1]

BoostCaps:a boosted capsule network for brain tumor classification

[C]//

Joint training of two-channel deep neural network for brain tumor classification

[J].

Med-nca: Robust and lightweight segmentation with neural cellular automata

[C]//

Deep learning and spark architecture based intelligent brain tumor MRI image severity classification

[J].DOI:10.1016/j.bspc.2022.103644 URL [本文引用: 1]

Cbam: Convolutional block attention module

[C]//

Triple classification of BI-RADS 3-5 breast lesions based on MRI radiomics

[J].

基于MRI影像组学的BI-RADS 3-5类乳腺病变三分类

[J].医生根据磁共振影像征象对患者的乳腺病变程度进行BI-RADS分类评估时存在一定的主观性,且 BI-RADS 3-5类病变的良恶性存在交叉,在临床诊断时极易发生因诊断类别较高而造成不必要的有创治疗.针对这些问题,本文应用影像组学技术对乳腺的T<sub>1</sub>加权(T1W)和动态对比增强(DCE)磁共振图像进行特征提取和融合,采用最小绝对收缩和选择算子(LASSO)算法筛选出各特征集的最优特征集,并分别使用支持向量机(SVM)、随机森林(RF)、K最近邻(KNN)及逻辑回归(LR)算法进行BI-RADS 3-5类乳腺病变三分类,并且在此基础上实现乳腺良恶性分类.结果显示基于特征融合的四个影像组学模型对乳腺病变BI-RADS 3-5类的分类准确率分别为81.25%、87.50%、78.38%、81.25%;对乳腺病变良恶性鉴别的准确率分别为90.91%、93.55%、92.73%、94.55%. 这表明MRI影像组学结合机器学习的算法对乳腺病变BI-RADS分类效果及良恶性鉴别效果均较好,且特征融合可进一步提高分类预测的准确率.

Self-attention generative adversarial networks

[C]//

Gcnet: Non-local networks meet squeeze-excitation networks and beyond

[C]//

A survey on cancer detection via convolutional neural networks: Current challenges and future directions

[J].DOI:10.1016/j.neunet.2023.11.006 URL [本文引用: 1]

Msenet: Multi-modal squeeze-and-excitation network for brain tumor severity prediction

[J].

DOI:10.1142/S0218001421570056

URL

[本文引用: 1]

Classification of brain tumors is one of the daunting tasks in medical imaging and incorrect decisions during the diagnosis process may lead to increased human fatality. Latest advances in artificial intelligence and deep learning have opened the path for the success of numerous medical image analysis tasks, including the recognition of brain tumors. In this paper, we propose a simple architecture based on deep learning that results in strong generalization without needing much preprocessing. The proposed Multi-modal Squeeze and Excitation model (MSENet) receives multiple representations of a given tumor image, learns end-to-end and effectively predicts the severity level of tumor. Convolution feature descriptors from multiple deep pre-trained models are used to effectively describe the tumor images and are supplied as input to the proposed MSENet. The squeeze and excitation blocks of the MSENet allow the model to prioritize tumor regions while giving less emphasis to the rest of the image, serving as an attention mechanism in the model. The proposed model is evaluated on the benchmark brain tumor dataset that is publicly accessible from the Figshare repository. Experimental studies reveal that in terms of model parameters, the proposed approach is simple and leads to competitive performance compared to those of existing complex models. By increasing complexity, the proposed model leads to generalize better and achieves state-of-the-art accuracy of 96.05% on Figshare dataset. Compared to the existing models, the proposed model neither uses segmentation nor uses augmentation techniques and without much pre-processing achieves competitive performance.

CDANet:Channel split dual attention based CNN for brain tumor classification in MR images[C]

//

Deep residual learning for image recognition

[C]//

Escaping the big data paradigm with compact transformers

[J].

Uniformer: Unifying convolution and self-attention for visual recognition

[J].DOI:10.1109/TPAMI.2023.3282631 URL [本文引用: 1]

Brain tumor/mass classification framework using magnetic-resonance-imaging-based isolated and developed transfer deep-learning model

[J].

DOI:10.3390/s22010372

URL

[本文引用: 2]

With the advancement in technology, machine learning can be applied to diagnose the mass/tumor in the brain using magnetic resonance imaging (MRI). This work proposes a novel developed transfer deep-learning model for the early diagnosis of brain tumors into their subclasses, such as pituitary, meningioma, and glioma. First, various layers of isolated convolutional-neural-network (CNN) models are built from scratch to check their performances for brain MRI images. Then, the 22-layer, binary-classification (tumor or no tumor) isolated-CNN model is re-utilized to re-adjust the neurons’ weights for classifying brain MRI images into tumor subclasses using the transfer-learning concept. As a result, the developed transfer-learned model has a high accuracy of 95.75% for the MRI images of the same MRI machine. Furthermore, the developed transfer-learned model has also been tested using the brain MRI images of another machine to validate its adaptability, general capability, and reliability for real-time application in the future. The results showed that the proposed model has a high accuracy of 96.89% for an unseen brain MRI dataset. Thus, the proposed deep-learning framework can help doctors and radiologists diagnose brain tumors early.

A new deep hybrid boosted and ensemble learning-based brain tumor analysis using MRI

[J].

DOI:10.3390/s22072726

URL

[本文引用: 1]

Brain tumor analysis is essential to the timely diagnosis and effective treatment of patients. Tumor analysis is challenging because of tumor morphology factors like size, location, texture, and heteromorphic appearance in medical images. In this regard, a novel two-phase deep learning-based framework is proposed to detect and categorize brain tumors in magnetic resonance images (MRIs). In the first phase, a novel deep-boosted features space and ensemble classifiers (DBFS-EC) scheme is proposed to effectively detect tumor MRI images from healthy individuals. The deep-boosted feature space is achieved through customized and well-performing deep convolutional neural networks (CNNs), and consequently, fed into the ensemble of machine learning (ML) classifiers. While in the second phase, a new hybrid features fusion-based brain-tumor classification approach is proposed, comprised of both static and dynamic features with an ML classifier to categorize different tumor types. The dynamic features are extracted from the proposed brain region-edge net (BRAIN-RENet) CNN, which is able to learn the heteromorphic and inconsistent behavior of various tumors. In contrast, the static features are extracted by using a histogram of gradients (HOG) feature descriptor. The effectiveness of the proposed two-phase brain tumor analysis framework is validated on two standard benchmark datasets, which were collected from Kaggle and Figshare and contain different types of tumors, including glioma, meningioma, pituitary, and normal images. Experimental results suggest that the proposed DBFS-EC detection scheme outperforms the standard and achieved accuracy (99.56%), precision (0.9991), recall (0.9899), F1-Score (0.9945), MCC (0.9892), and AUC-PR (0.9990). The classification scheme, based on the fusion of feature spaces of proposed BRAIN-RENet and HOG, outperform state-of-the-art methods significantly in terms of recall (0.9913), precision (0.9906), accuracy (99.20%), and F1-Score (0.9909) in the CE-MRI dataset.

Dynamic convolution: Attention over convolution kernels

[C]//

Development and interpretation of a pathomics-based model for the prediction of microsatellite instability in Colorectal Cancer

[J].

DOI:10.7150/thno.49864

PMID:33042271

[本文引用: 1]

Microsatellite instability (MSI) has been approved as a pan-cancer biomarker for immune checkpoint blockade (ICB) therapy. However, current MSI identification methods are not available for all patients. We proposed an ensemble multiple instance deep learning model to predict microsatellite status based on histopathology images, and interpreted the pathomics-based model with multi-omics correlation. Two cohorts of patients were collected, including 429 from The Cancer Genome Atlas (TCGA-COAD) and 785 from an Asian colorectal cancer (CRC) cohort (Asian-CRC). We established the pathomics model, named Ensembled Patch Likelihood Aggregation (EPLA), based on two consecutive stages: patch-level prediction and WSI-level prediction. The initial model was developed and validated in TCGA-COAD, and then generalized in Asian-CRC through transfer learning. The pathological signatures extracted from the model were analyzed with genomic and transcriptomic profiles for model interpretation. The EPLA model achieved an area-under-the-curve (AUC) of 0.8848 (95% CI: 0.8185-0.9512) in the TCGA-COAD test set and an AUC of 0.8504 (95% CI: 0.7591-0.9323) in the external validation set Asian-CRC after transfer learning. Notably, EPLA captured the relationship between pathological phenotype of poor differentiation and MSI (< 0.001). Furthermore, the five pathological imaging signatures identified from the EPLA model were associated with mutation burden and DNA damage repair related genotype in the genomic profiles, and antitumor immunity activated pathway in the transcriptomic profiles. Our pathomics-based deep learning model can effectively predict MSI from histopathology images and is transferable to a new patient cohort. The interpretability of our model by association with pathological, genomic and transcriptomic phenotypes lays the foundation for prospective clinical trials of the application of this artificial intelligence (AI) platform in ICB therapy.© The author(s).

Skin cancer detection using dermoscopic images with convolutional neural network

[J].DOI:10.1038/s41598-025-91446-6 [本文引用: 1]

Self-DSNet: A novel self-ONNs based deep learning framework for multimodal driving distraction detection

[J].DOI:10.1109/ACCESS.2025.3545359 URL [本文引用: 1]

Brain CT image classification based on mask RCNN and attention mechanism

[J].DOI:10.1038/s41598-024-78566-1 [本文引用: 1]

Robust brain MRI image classification with SIBOW-SVM

[J].DOI:10.1016/j.compmedimag.2024.102451 URL [本文引用: 1]

Dual-pathway EEG model with channel attention for virtual reality motion sickness detection

[J].DOI:10.1016/j.jneumeth.2025.110425 URL

Improved grain boundary reconstruction method based on channel attention mechanism

[J].

DOI:10.3390/ma18020253

URL

[本文引用: 1]

The grain size of metal materials has a significant impact on their macroscopic properties. However, original metallographic images often suffer from issues such as substantial noise, missing grain boundaries, low contrast, and blurred edges. These challenges hinder the accurate extraction of complete grain boundaries, limiting the precision of grain size measurement and material performance prediction. Therefore, effectively reconstructing incomplete grain boundaries is particularly crucial. This paper proposes a grain boundary reconstruction and grain size measurement method based on an improved channel attention mechanism. A generative adversarial network (GAN) serves as the backbone, with a custom-designed channel attention module embedded in the generator. Combined with a global context attention mechanism, the method captures the global contextual information of the image, enhancing the network’s semantic understanding and reconstruction accuracy for regions with missing grain boundaries. During the image reconstruction process, the method effectively leverages long-range feature correlations within the image, significantly improving network performance. To address the Mode Collapse observed during experiments, the loss function is optimized using Focal Loss, balancing the ratio of positive and negative samples and improving network robustness. Compared with other attention modules, the improved channel attention module significantly enhances the performance of the generative network. Experimental results demonstrate that the generative network based on this module outperforms comparable modules in terms of MIoU (86.25%), Accuracy (95.06%), and Precision (86.54%). The grain boundary reconstruction method based on the improved channel attention mechanism not only effectively improves the accuracy of grain boundary reconstruction but also significantly enhances the generalization ability of the network. This provides reliable technical support for the characterization of the microstructure and the performance prediction of metal materials.

Improving detection and classification of brain tumors using DenseNet201

[J].